Деепфакес видеа значе да не можете веровати свему што видите. Сада, аудио фактуре могу значити да више не можете веровати својим ушима. Да ли је то заиста председник објавио рат Канади? Да ли је то заиста твој тата на телефону и тражи његову лозинку за е-пошту?

Додајте још једну егзистенцијалну бригу на листу како би нас сопствена охолост неизбежно могла уништити. Током Реганове ере, једини прави технолошки ризици били су претња нуклеарним, хемијским и биолошким ратом.

У наредним годинама, имали смо прилику да будемо опседнути сивом гљивицом нанотехнологије и глобалним пандемијама. Сада имамо дубоке лажне ствари — људи који губе контролу над својим ликом или гласом.

Преглед садржаја

Шта је аудио Деепфаке?

Већина нас је видела видео-деепфаке, у којем се алгоритми дубоког учења користе да би се једна особа заменила нечијим ликом. Најбољи су узнемирујуће реалистични, а сада је на реду аудио. Аудио деепфаке је када се „клонирани“ глас који се потенцијално не разликује од гласа стварне особе користи за производњу синтетичког звука.

„То је као Пхотосхоп за глас“, рекао је Зохаиб Ахмед, извршни директор Слично АИ, о технологији клонирања гласа његове компаније.

Међутим, лоши послови у Пхотосхопу се лако разоткривају. Безбедносна фирма са којом смо разговарали каже да људи обично само нагађају да ли је аудио лажан или лажан са тачношћу од око 57 процената – ништа боље од бацања новчића.

Поред тога, пошто су многи гласовни снимци телефонских позива лошег квалитета (или снимљени на бучним локацијама), аудио фактуре могу да се учине још више неразлучивим. Што је квалитет звука лошији, то је теже уочити те знакове да глас није стваран.

Али зашто би некоме уопште био потребан Пхотосхоп за гласове?

Убедљив случај за синтетички аудио

Заправо постоји огромна потражња за синтетичким звуком. Према Ахмеду, „повраћај улагања је веома тренутан“.

Ово је посебно тачно када је у питању играње игара. У прошлости је говор био једина компонента у игри коју је било немогуће створити на захтев. Чак иу интерактивним насловима са сценама биоскопског квалитета приказаним у реалном времену, вербалне интеракције са ликовима који се не играју увек су у суштини статичне.

Сада је, међутим, технологија сустигла корак. Студији имају потенцијал да клонирају глас глумца и користе механизме за претварање текста у говор тако да ликови могу рећи било шта у реалном времену.

Постоје и традиционалније употребе у оглашавању, техничкој и корисничкој подршци. Овде је важан глас који звучи аутентично људски и који одговара лично и контекстуално без људског доприноса.

Компаније за клонирање гласа су такође узбуђене због медицинских апликација. Наравно, замена гласа није ништа ново у медицини — Стивен Хокинг је славно користио роботски синтетизовани глас након што је изгубио сопствени 1985. Међутим, модерно клонирање гласа обећава нешто још боље.

У 2008, компанија за синтетички глас, ЦереПроц, дао је покојном филмском критичару Роџеру Еберту свој глас након што га је рак однео. ЦереПроц је објавио веб страницу која је омогућавала људима да куцају поруке које би потом биле изговорене гласом бившег председника Џорџа Буша.

„Еберт је то видео и помислио је, ‘па, ако су могли да копирају Бушов глас, требало би да могу да копирају и мој’, рекао је Метју Ејлет, главни научни службеник ЦереПроца. Еберт је затим замолио компанију да направи заменски глас, што су и урадили обрадом велике библиотеке гласовних снимака.

„Био је то један од првих пута да је неко то урадио и био је прави успех“, рекла је Ајлет.

Последњих година, бројне компаније (укључујући ЦереПроц) су радиле са Удружење АЛС на Пројецт Ревоице да обезбеди синтетичке гласове онима који пате од АЛС.

Како ради синтетички аудио

Клонирање гласа тренутно има тренутак, а мноштво компанија развија алате. Слично АИ и Опис имају демо презентације на мрежи које свако може испробати бесплатно. Само снимите фразе које се појављују на екрану и, за само неколико минута, креира се модел вашег гласа.

Можете захвалити АИ – посебно алгоритмима за дубоко учење – што су у стању да упаре снимљени говор са текстом да бисте разумели компоненте фонема које чине ваш глас. Затим користи резултујуће лингвистичке градивне блокове да би приближио речи које није чуо да говорите.

Основна технологија постоји већ неко време, али како је Ајлет истакла, потребна је помоћ.

„Копирање гласа је било попут прављења пецива“, рекао је. „Било је то тешко за урадити и било је различитих начина на које сте морали да га подесите ручно да бисте га натерали да ради.

Програмерима су биле потребне огромне количине снимљених гласовних података да би добили задовољавајуће резултате. Онда су се, пре неколико година, отвориле капије за воду. Истраживање у области компјутерског вида показало се критичним. Научници су развили генеративне адверсаријске мреже (ГАН), које су по први пут могле да екстраполирају и дају предвиђања на основу постојећих података.

„Уместо да компјутер види слику коња и каже ‘ово је коњ’, мој модел би сада могао да од коња направи зебру,“ рекла је Ајлет. „Дакле, експлозија у синтези говора сада је захваљујући академском раду из компјутерског вида.“

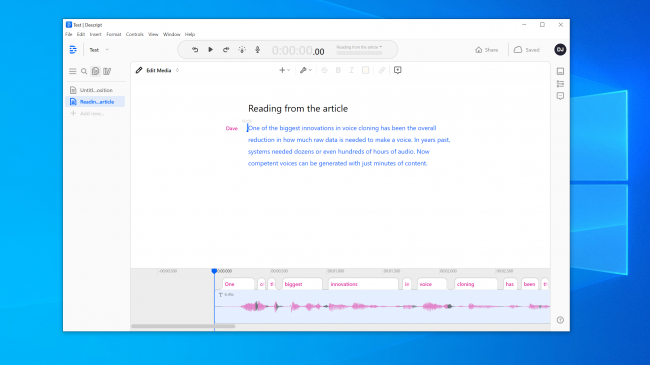

Једна од највећих иновација у клонирању гласа је свеукупно смањење количине необрађених података које је потребно за стварање гласа. У прошлости, системима су биле потребне десетине или чак стотине сати звука. Сада се, међутим, компетентни гласови могу генерисати из само неколико минута садржаја.

Егзистенцијални страх од неповерења у било шта

Ова технологија, заједно са нуклеарном енергијом, нанотехнологијом, 3Д штампањем и ЦРИСПР-ом, истовремено је узбудљива и застрашујућа. На крају крајева, већ је било случајева у вестима да су људи преварени од стране гласовних клонова. У 2019, компанија у Великој Британији је тврдила да јесте преварен аудио-фајком телефонски позив у слање новца криминалцима.

Не морате ићи далеко да бисте пронашли изненађујуће убедљиве аудио лажне. ИоуТубе канал Воцал Синтхесис приказује познате људе који говоре ствари које никада нису рекли, нпр Џорџ В. Буш чита „Ин Да Цлуб” 50 Цент. На месту је.

На другим местима на Јутјубу можете чути јато бивших председника, укључујући Обама, Клинтон и Реган, репују НВА. Музика и позадински звуци помажу да се прикрију неке од очигледних роботских грешака, али чак и у овом несавршеном стању, потенцијал је очигледан.

Експериментисали смо са укљученим алатима Слично АИ и Опис и створио клон гласа. Десцрипт користи мотор за клонирање гласа који се првобитно звао Лиребирд и био је посебно импресиван. Били смо шокирани квалитетом. Узнемирујуће је чути свој глас како говори ствари за које знате да никада нисте рекли.

Дефинитивно постоји роботски квалитет у говору, али уз опуштено слушање, већина људи не би имала разлога да мисли да је лажна.

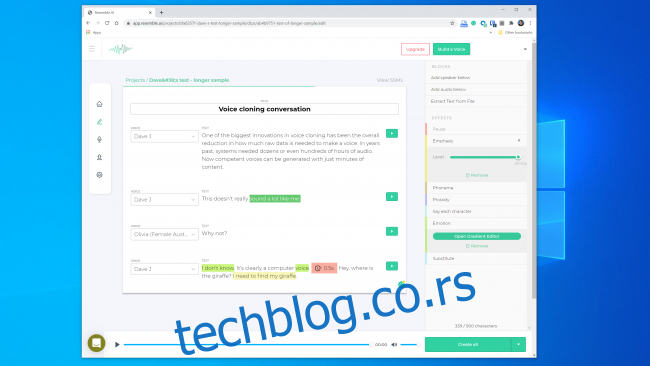

Имали смо још веће наде за Ресембле АИ. Даје вам алате за креирање разговора са више гласова и варирање изражајности, емоција и темпа дијалога. Међутим, нисмо мислили да гласовни модел обухвата основне квалитете гласа који смо користили. У ствари, мало је вероватно да ће то било кога преварити.

Представник Ресембле АИ нам је рекао да је „већина људи одушевљена резултатима ако то ураде како треба“. Два пута смо направили гласовни модел са сличним резултатима. Дакле, очигледно, није увек лако направити гласовни клон који можете користити да изведете дигиталну пљачку.

Упркос томе, оснивач Лиребирд-а (који је сада део Десцрипта), Кундан Кумар, сматра да смо већ прешли тај праг.

„У малом проценту случајева већ постоји“, рекао је Кумар. „Ако користим синтетички звук да променим неколико речи у говору, то је већ толико добро да ћете тешко знати шта се променило.“

Такође можемо претпоставити да ће ова технологија временом постати само боља. Системима ће бити потребно мање звука за креирање модела, а бржи процесори ће моћи да направе модел у реалном времену. Паметнија вештачка интелигенција ће научити како да дода убедљивију каденцу налик људској и нагласак на говору без примера за рад.

Што значи да се можда приближавамо широко распрострањеној доступности клонирања гласа без напора.

Етика Пандорине кутије

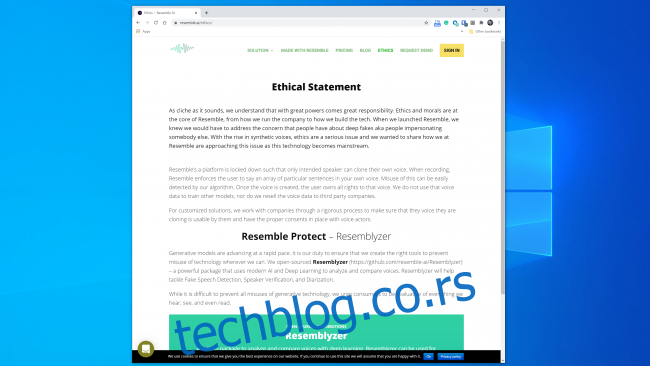

Чини се да је већина компанија које раде у овом простору спремна да рукују технологијом на безбедан и одговоран начин. Слично АИ, на пример, има цео одељак „Етика“ на својој веб страници, а охрабрује следећи извод:

„Радимо са компанијама кроз ригорозан процес како бисмо били сигурни да глас који клонирају могу да користе и да имају одговарајуће сагласности са гласовним актерима.

Исто тако, Кумар је рекао да је Лиребирд од почетка забринут због злоупотребе. Зато сада, као део Дескрипта, дозвољава људима само да клонирају сопствени глас. У ствари, и Ресембле и Десцрипт захтевају да људи снимају своје узорке уживо како би спречили клонирање гласа без сагласности.

Охрабрујуће је што су главни комерцијални играчи наметнули неке етичке смернице. Међутим, важно је запамтити да ове компаније нису чувари ове технологије. Постоји велики број алата отвореног кода који су већ у дивљини, за које не постоје правила. Према Хенрију Ајдеру, шефу обавештајне службе у Деептраце, такође вам није потребно напредно знање кодирања да бисте га злоупотребили.

„Много напретка у простору је дошло кроз заједнички рад на местима као што је ГитХуб, користећи имплементације претходно објављених академских радова отвореног кода“, рекао је Ајдер. „Могу га користити свако ко има умерено знање кодирања.“

Стручњаци за безбедност су све ово већ видели

Криминалци су покушали да украду новац телефоном много пре него што је клонирање гласа било могуће, а стручњаци за безбедност су увек били на располагању да то открију и спрече. Предузеће за обезбеђење Пиндроп покушава да заустави банковну превару тако што проверава да ли је позивалац онај за кога тврди да је из аудио записа. Само у 2019. Пиндроп тврди да је анализирао 1,2 милијарде гласовних интеракција и спречио око 470 милиона долара у покушајима преваре.

Пре клонирања гласа, преваранти су испробали низ других техника. Најједноставнији је био позив са другог места са личним подацима о жигу.

„Наш акустични потпис нам омогућава да утврдимо да позив заправо долази са Скипе телефона у Нигерији због карактеристика звука“, рекао је извршни директор Пиндропа, Вијаи Баласубраманииан. „Онда, можемо упоредити да знајући да купац користи АТ&Т телефон у Атланти.“

Неки криминалци су такође направили каријеру користећи позадинске звуке како би одбацили банкарске представнике.

„Постоји преварант кога смо звали Цхицкен Ман који је увек имао петлове у позадини“, рекао је Баласубраманијан. „И постоји једна дама која је користила бебу која плаче у позадини да у суштини убеди агенте кол центра да ‘хеј, пролазим кроз тежак период’ да добије саосећање.“

А ту су и мушки криминалци који траже банковне рачуне жена.

„Користе технологију да повећају фреквенцију свог гласа, да звуче женственије“, објаснио је Баласубраманијан. Ово може бити успешно, али „повремено се софтвер забрља и звуче као Алвин и веверице“.

Наравно, клонирање гласа је само најновији развој у овом све ескалирајућем рату. Безбедносне фирме су већ ухватиле преваранте који користе синтетички звук у најмање једном нападу подводног риболова.

„Са правом метом, исплата може бити огромна“, рекао је Баласубраманијан. „Дакле, има смисла посветити време стварању синтетизованог гласа правог појединца.“

Може ли неко рећи да ли је глас лажан?

Када је у питању препознавање да ли је глас лажиран, постоје и добре и лоше вести. Лоше је што су гласовни клонови сваким даном све бољи. Системи за дубоко учење постају паметнији и праве аутентичније гласове за које је потребно мање звука за стварање.

Као што можете видети из овог клипа од Председник Обама говори МЦ Рену да заузме став, такође смо већ дошли до тачке у којој високо верни, пажљиво конструисани гласовни модел може да звучи прилично убедљиво људском уху.

Што је звучни снимак дужи, већа је вероватноћа да ћете приметити да нешто није у реду. За краће клипове, међутим, можда нећете приметити да је синтетички – посебно ако немате разлога да сумњате у његову легитимност.

Што је квалитет звука јаснији, лакше је уочити знаке аудио лажног звука. Ако неко говори директно у микрофон студијског квалитета, моћи ћете да пажљиво слушате. Али снимак телефонског позива лошег квалитета или разговор снимљен на ручни уређај у бучној паркинг гаражи биће много теже проценити.

Добра вест је да чак и ако људи имају проблема да одвоје право од лажног, рачунари немају иста ограничења. На срећу, алати за гласовну верификацију већ постоје. Пиндроп има један који супротставља системе дубоког учења један против другог. Користи оба да открије да ли је аудио узорак особа каква би требало да буде. Међутим, такође испитује да ли човек уопште може да произведе све звукове у узорку.

У зависности од квалитета звука, свака секунда говора садржи између 8.000-50.000 узорака података који се могу анализирати.

„Ствари које обично тражимо су ограничења говора због људске еволуције“, објаснио је Баласубраманијан.

На пример, два вокална звука имају минималну могућу одвојеност један од другог. То је зато што их физички није могуће изговорити брже због брзине којом се мишићи у вашим устима и гласне жице могу реконфигурисати.

„Када гледамо синтетизовани звук“, рекао је Баласубраманијан, „понекад видимо ствари и кажемо: „ово никада није могао да произведе човек, јер једина особа која је могла да генерише ово мора да има врат дуг седам стопа. ”

Постоји и класа звука која се зове „фрикативи“. Настају када ваздух пролази кроз уско сужење у вашем грлу када изговарате слова као што су ф, с, в и з. Системима за дубоко учење је посебно тешко савладати фрикативе јер софтвер има проблема да их разликује од буке.

Дакле, барем за сада, софтвер за клонирање гласа је посрнуо због чињенице да су људи вреће меса које струју ваздух кроз рупе у својим